基于图形处理器的电力系统稀疏线性方程组求解方法

稳定空间 时间:2021-01-10 阅读:()

周挺辉1,赵文恺1,严正1,徐得超2,江涵2(1.

电力传输与功率变换控制教育部重点实验室(上海交通大学),上海市200240;2.

中国电力科学研究院,北京市100192)摘要:针对电力系统大规模线性方程组的稀疏特点,提出了基于图形处理器(GPU)的直接求解方法.

该方法首先利用基于先排序的分块对角加边形式(BBDF)划分方法对方程组系数矩阵进行分割,形成具有粗粒度和细粒度两层并行结构的线性方程组,然后利用GPU的线程块和线程并行特性对其分别予以求解.

将上述方法应用到电力系统暂态稳定计算中,并对其加速效果进行了测试.

测试结果表明,在目前普及的设备上,所提方法可获得3~4倍的加速比;在高端设备上,能够获得7~8倍的加速比.

关键词:电力系统;并行计算;暂态稳定计算;图形处理器;稀疏技术;加速比收稿日期:2013G11G15;修回日期:2014G06G23.

国家电网公司大电网重大专项资助项目(SGCCGMPLG018G2012);高等学校博士学科点专项科研基金资助项目(20120073110020).

0引言现代电网运行工况复杂、难以预测.

为提高计算速度,单纯地采用简化模型或改进算法无法取得突破性进展[1],为此,并行计算成为了解决此类问题的有效途径之一.

大部分电力系统并行计算都是针对稀疏线性方程组进行的.

对于粗粒度并行结构而言,将线性方程组的系数矩阵划分为分块对角加边形式(BBDF),是提高并行计算效率的有效方法.

文献[2G3]先把电力系统分割为若干联系松散的区域,再对各区域进行并行计算.

文献[4G5]研究了电力系统潮流及暂态稳定计算的并行化方法.

文献[6G7]在个人计算机(PC)机群下利用上述算法实现了暂态稳定的并行计算,主要是对方程组的求解过程实现了多机的并行化,并获得了显著的加速效果.

近年来,多核CPU架构成为总体的发展趋势,文献[8]对此进行了研究,并在4核CPU机器上获得了3倍左右的加速效果.

并行体系架构的革新,使得把多个核心集成于同一块芯片上、以数量来弥补速度的不足成为可能.

多核CPU架构是其中的一种,众核图形处理器(GPU)架构是另一种.

统一计算设备架构(computeunifieddevicearchitecture,CUDA)的问世,使得GPU具备了通用计算的能力,为大型电力系统并行计算提供了新的途径.

文献[9G10]在CPUGGPU混合架构下,用稳定的双共轭梯度法实现了大型电力系统暂态稳定的超实时仿真计算.

文献[11]利用GPU以及广义最小残差方法(GMRES)实现了电力系统暂态稳定仿真计算,且在系统规模较大时取得了一定的成效.

文献[12]利用GPU实现了基于隐式梯形积分的机电暂态稳定仿真计算.

对于大规模稀疏线性方程组并行求解问题,若采用BBDF划分方法,则在众核GPU架构下,BBDF划分是否仍能够胜任细粒度的并行结构,需要进一步研究与探讨;若采用迭代法,虽然非常适合于众核GPU架构,但预处理的选择问题却很难解决;若采用直接法,则虽然不存在难收敛的问题,但在CPUGGPU混合架构下,如何处理方程组的稀疏性,又是一个值得研究的问题.

为了解决这2个问题,本文首先论证了先排序BBDF划分方法对于细粒度并行计算的可行性,其次,利用GPU的线程块(block)和线程(thread)并行特性,对具有粗/细粒度两层并行结构的线性方程组,提出了面向稀疏线性方程组的直接求解方法.

1众核GPU并行环境介绍NVIDIA公司在2007年推出了CUDA,使GPU能够用于图像处理以外的一般计算.

其与CPU主要的区别在于,CPU拥有较少的核心数目,47第39卷第2期2015年1月25日Vol.

39No.

2Jan.

25,2015DOI:10.

7500/AEPS20131115005http://www.

aepsGinfo.

com但功能强大;而GPU每个核心的处理能力不强,但一个芯片上能汇集众多的核心,如图1所示.

图1CPU和GPU的架构比较Fig.

1ArchitecturecomparisonofCPUandGPUCUDA技术的程序执行模型如图2所示[11],其从硬件上支持两层的并行结构:线程和线程块.

各个线程块间可以并行地执行,但相互之间不能高效地进行通信,可以形成粗粒度的并行.

而同一线程块内的不同线程可共享内存,实现线程间同步,形成细粒度的并行.

本文针对电力系统仿真计算的特点,研究基于线程块和线程上的并行,形成线程块间的粗粒度并行和线程间的细粒度并行.

图2中,线程块和线程均以2维予以展示,分别用Block(i,j)(i=0,1,2;j=0,1)和Thread(i,j)(i=0,1,2,3;j=0,1,2)表示.

但实际上采用1维、2维均可.

图2CUDA技术的程序执行模型Fig.

2ProgramexecutionmodelwithCUDAtechnology2电力系统仿真计算并行方案考虑到电力系统有其特殊的稀疏结构,因此,直接采用针对满阵的求解方法[13],抑或是基于稠密分块的多波前方法[14],都是不合适的.

本节以暂态稳定计算为例,对电力系统仿真计算的并行方案进行简要介绍后,给出了基于先排序的BBDF划分方法能够应用于粗/细粒度并行结构的依据,然后介绍了所提方法的原理和技术实现细节.

2.

1电力系统仿真计算的并行方案概述图3为用于暂态稳定计算的数学模型框架[15].

图3暂态稳定计算中系统数学模型框架Fig.

3Frameworkofsystemmodelintransientstabilitycalulation系统中的绝大部分动态元件都是相互独立的,仅通过电力网络连接形成统一的整体.

系统的数学模型可以描述为如下一般形式的微分—代数方程组:dxdt=f(x,y)(1)0=g(x,y)(2)式中:x为微分方程组中描述系统动态特性的状态变量;y为系统的代数变量.

常规解法有交替求解法和联立求解法.

本文采用的是交替迭代求解法.

但无论采取何种策略,在求解过程中都会形成大规模稀疏线性方程组,研究重点都是一致的(具体分析见附录A).

2.

2并行方案分析对于粗粒度并行计算,首先要将方程组的系数矩阵A划分为形如式(3)的BBDF[2G4,6,8].

A=A11A1cA22A2cAkkAkcAc1Ac2AckAccéêêêêêêêùúúúúúúú(3)式(3)的物理意义在于:将原始节点集合划分为若干互不关联的子集合和一个规模较小的联系节点集合(见图4).

其中,联系节点集合对应BBDF中的边界块Acc,各子集合对应BBDF中的对角块Aii,i=1,2,,k.

图4节点划分示意图Fig.

4Schematicdiagramofsystempartitioning一般观点认为,这种方法不适合于众核GPU.

其原因在于,为了能够充分利用GPU的众多核心,需要将节点集合分为数量足够多的子集合,这会导57周挺辉,等基于图形处理器的电力系统稀疏线性方程组求解方法致联系节点集合的规模急剧增大.

然而,对于先排序的BBDF划分,事实却并非如此,具体分析如下.

假设已采用了最小度最小深度(MDML)法[16]对所有节点进行了重排序.

由于所需要的子集合较多,故采用文献[8]提及的分区方法进行集合划分.

在多核CPU环境下,子集合的个数Q一般取为2至4.

但对于GPU来说,所需要的Q较大.

以3872条母线系统为例,测试不同分区数对联系节点集合的影响,如图5所示,具体数字参考附录B.

图5不同分区数目对联系节点集合的影响Fig.

5Effectofdifferentnumbersofpartitionsonlinkingsystem曲线符合对数特征.

对该曲线进行对数拟合后,得到以下结果:Y=-0.

307+0.

553ln(Q)(4)式中:Q为分区数;Y为联系节点集合所占百分比.

式(4)对图5曲线拟合程度较好,联系节点集合规模增加趋向平缓.

当分区数为64时,联系节点集合仅占2%.

因此,对大规模系统使用先排序BBDF方法将节点集合划分为几十个子集,是可行的.

2.

3暂态稳定并行计算的具体设计根据前文的研究,并将其应用到电力系统的暂态稳定分析中,可确定如下的计算方案:由CPU进行逻辑复杂的前期处理,在形成大规模稀疏方程组后,交由GPU进行方程的求解.

以交替求解法为例,算法流程如图6所示,联立求解法类似.

图6并行计算算法流程Fig.

6Flowchartofparallelalgorithm图6中解算网络方程的具体流程见图7.

图7(a)为CPU并行处理的流程,作为参考.

图7(b)为本文的研究,不同于CPU,其额外拥有两步"数据"处理的操作,其原因为CPU与GPU拥有不同的内存空间,需要对其数据进行同步处理.

图7CPU或GPU解方程组Fig.

7FlowchartofsolvingequationsonCPUorGPU对于非解方程部分,其并行化则相对较为简单.

由于各元件对系统的影响都较为独立,可以简单地分配到众多的核心中进行求解,具体参考附录C.

因此,仿真中并行化的难点在于前文重点分析的大规模稀疏线性方程组的求解.

本文在进行因子分解时,根据GPU的特点,制定出以下两层并行结构.

1)线程块层面的并行结构根据式(3),每个AiiAicAci0éêêùúú(i=1,2,,k)的因子分解相互独立,其可以交由GPU的多个线程块进行处理.

然而与文献[8]类似,此时由于每个线程块之间不能简单地交互数据,故暂时不能修正由每个Aii因子分解时对Acc的影响,而只修正了Aci和Aic.

此过程利用了GPU的线程块特性,实现了对方程组求解的粗粒度并行.

2)线程层面的并行结构在每个线程块的因子化过程中,可派生多个线程对其进行并行化,实现细粒度的并行.

为简单起见,以下面5阶的矩阵a为例说明.

a=a11a12a14a15a21a22a24a25a33a35a41a42a44a45a51a52a53a54a55éêêêêêêêùúúúúúúú(5)在第i步,包含归一化和秩一修正2个过程.

归一化过程:i=1时,需要对a12,a14,a15进行归一化,其相互是没有关联性的.

在实际操作过程当中,可以开辟32条线程.

当需要归一化的元素个数少于32个时,某些线程实质上不需要进行操作.

672015,39(2)学术研究http://www.

aepsGinfo.

com当元素个数多于32个时,某些线程会串行地对不止一个元素进行归一化.

下文开辟多线程也类似处理.

秩一修正过程:i=1时,实际上需要进行处理的元素是a22,a24,a25,a42,a44,a45,a52,a54,a55.

这些元素处于归一化时a12,a14,a15所在的列(第2,4,5列)与第2,4,5行的相交位置.

而其他位置的元素无论其是否非零元,均不会受到影响.

而需要修正的这些元素之间并不存在依赖关系,也可以实现线程级别的并行.

当i=1处理完毕时,以同样的策略处理i=2,3,,直到处理完毕所有的行.

此过程利用了GPU的线程特性,实现了对方程组求解的细粒度并行.

上述过程实现了对式(3)中各个子块的因子化.

当每个分块处理完毕后,需要对Acc进行修正:Acc,new=Acc,old-[Ac1Ac2Ack]A1cA2cAkcéêêêêêùúúúúú(6)Acc中的每个元素的修正均是独立的,可以同样地通过开辟多个线程进行处理.

Acc修正完毕后,需要对Acc,new进行因子化,过程与之前每个分块的方法一致,这里不再重复.

当因子化过程完成以后,进入前代回代过程.

与因子化过程一样,前代也可以形成两层的并行.

1)线程块层面的并行:式(3)的每个对角块交由GPU的一个线程块处理.

2)线程层面的并行:同样以式(5)为例,假设右端项为[b1,b2,b3,b4,b5]T.

当i=1时,首先对b1进行归一化处理,b2,b4,b5可以并行地进行修正.

当i=2时,对b2进行归一化处理,而后b4,b5可以并行地进行修正.

需要注意的是,此过程的修正仅针对Aii,i=1,2,,k;对于边界系统,需要额外处理.

上述过程完成后,需要研究[Ac1,Ac2,,Ack]对右端项的影响.

由于此矩阵中的第i行会且只会影响到右端项对应的bi,因此可为受到影响的每个bi开辟一个线程,进行并行处理.

回代过程与之类似.

因子化过程和前代回代过程分别见附录D图D1和图D2.

为了能够充分利用GPU的性能,实现过程中应尽量保证CUDA核心处于满负荷计算状态.

在图D1所示的过程中多线程块多线程区域,共开辟了32*k条线程同时执行.

在2.

2节中已经予以说明,k可以取为较大的数值,且保持联系节点集合的规模在可以接受的范围内.

若k>30,则32k>960,已经超过了CUDA核心的数目(本文测试环境GTX570为480个核心),足以给各个核心分配一定的计算量.

这也是即便要付出增加联系系统规模的代价下,也要划分众多子网的原因.

对于具体的某个CUDA核心,在某个分区不需要它的时候,可以由另外的分区进行调用,以消除等待时间.

由于GPU可以在不同线程间几乎零延时地进行切换(即一个CUDA核心可以在不同线程间来回切换,而不需要额外的时钟周期),因此较多的线程可以在一定程度上均衡CUDA核心的计算量.

综上所述,本文结合GPU运行环境实现了两层并行结构的方法,实现了大规模稀疏线性方程组在GPU中的求解,并应用到电力系统暂态稳定计算中.

3算例测试与分析3.

1仿真环境及技术指标本文使用VisualStudio2012作为开发环境,nVidiaCUDAToolkit5.

5作为GPU开发工具,采用C++及CUDA语言分别编写了运行于CPU上串行暂态计算程序和基于GPU的并行暂态计算程序.

两种程序采用相同算法框架,并且都应用稀疏存储技术,区别在于线性方程组求解过程是在CPU还是GPU上进行.

硬件平台如下:CPU为intelCorei52320/3GHz,内存8GB;GPU为nVidiaGeforceGTX570,运行环境MicrosoftWindows8.

1x64.

主要测试算例参数见表1,其中7800案例为利用IEEE300系统倍增26倍形成,7744系统为利用3872系统倍增形成.

初始潮流收敛且系统稳定.

微分方程采用改进欧拉法求解,代数方程采用高斯消元法直接求解,整体采用交替求解法.

故障设定为某母线出线端发生三相接地短路,延时切除故障.

计算步长为0.

005s,数据采用双精度.

表1测试案例参数Table1Parametersoftestcases测试案例母线数目支路数目发电机数目1056案例105613012703872案例387247889907744案例7744957719807800案例7800107861794本文主要考察程序进行并行化后的效率提升,并用式(7)所示的加速比技术指标来表示.

加速比=串行执行时间并行执行时间(7)77周挺辉,等基于图形处理器的电力系统稀疏线性方程组求解方法3.

2计算结果与分析3.

2.

1计算参数设置及结果由于在GPU上可调参数较多,例如分区个数、GPU上开辟的线程块数目、每个线程块内的线程数等均可调整,因此本文首先通过一系列的测试,确定参数的设置,具体设置见附录D.

对于多线程块多线程区域每个线程块开辟32条线程、单线程块多线程区域开辟1024条线程能够获得最优的加速效果.

在此基础上,表2显示了不同分区数对结果的影响.

表2不同分区数的测试结果Table2Testresultsofdifferentnumbersofpartitioning分区数执行时间/ms分区数执行时间/ms分区数执行时间/ms417921165021642391613200204381801877888172434169626421078773229241282803126144482717由于本文的设定为一个分区(即一个对角块)由GPU的一个线程块进行处理,因此表中的结果也即为线程块个数的设定.

对多个案例测试的经验结果表明,分区个数Q=0.

8~0.

9N(N为方程的总维数)时能够获得最优的效果.

此时,每个分区的维数约为1.

1N.

在上述设置下,联系系统的规模与各个子网的规模相差不大,前者约为单个后者的80%~90%.

测试中发现,联系系统的运算时间(包括各个子网对联系系统的修正过程)大约为全部子网运算时间的50%~60%,比重较大,因此再继续增大联系系统的规模就会影响并行效率.

根据以上结果,本文对测试案例进行分区时主要采取的设置参数如表3所示.

表3分区参数设置Table3Parametersettingsinpartitioning测试案例母线数分区个数指导阈值1056案例105640453872案例387270907744案例77441001407800案例7800100140注:指导阈值为文献[8]分区方法的参数设置,即前驱节点数超过此值的节点,直接纳入到联系系统.

本文使用微软的VC编译器和英伟达的NVCC编译器分别进行了测试,结果如表4和表5所示.

表4中,"GPU"指图7中由GPU进行的部分内容,其中包括了数据同步部分(即表5中的通信部分);"CPU"表示图7(a)部分内容,形成了与GPU部分的对照程序;"共同"则表示图6中为除网络方程求解外的其他内容,GPU程序和CPU对照程序均使用此部分内容,在计算加速比时将扣除此共同时间后再予以比较.

表4CPU和GPU对比测试结果Table4ComparativetestresultsonCPUandGPU测试案例执行时间/msCPU部分+共同部分GPU部分+共同部分共同部分加速比1056案例135411844211.

223872案例9336448218012.

817744案例423216247063.

847800案例423016327173.

84注:①四个案例仿真的总时长不一样,不可横向比较;②共同及CPU部分由VC编译,GPU部分由NVCC编译.

表5GPU部分通信占据测试结果Table5TestresultsofcommunicationsonGPU测试案例GPU部分执行时间/ms通信时间/ms通信占比/%加速比1056案例75941554.

72.

683872案例2681140752.

55.

917744案例91847852.

18.

017800案例91548052.

48.

07注:GPU部分扣除了通信时间.

从表4的结果可以看出,随着系统规模的增大,加速比的效率也随之增加,目前规模下可达3.

84;在同等矩阵规模下,已经明显优于使用广义最小残差迭代法(GMRES)结合GPU所带来的加速比[11].

表5给出了各个案例下数据同步(即CPU、GPU内存间通信)所占据时间的比例,一般在50%~60%左右.

若扣除此部分时间,只考察GPU和CPU在解稀疏方程组的加速效果,加速比则能够达到8以上.

但在应用过程中,同步时间是必要的,表4的数据更具参考价值.

3.

2.

2计算结果分析结合理论方法以及测试结果,具体分析如下所示.

1)经过预处理后,矩阵形成如式(3)所示的形式;为每个对角块分配一个线程块,同时为每个线程块分配了32个线程,形成了两层的并行结构.

结合稀疏技术后,每个CUDA核心仍可以满负荷地运行,充分发挥了GPU的性能,并获得了良好的效果.

而在联系节点集合的处理上,由于其相对比较稠密,根据文献[13],也能够有效发挥GPU的作用.

2)本文最大的加速比为3.

84,小于文献[12G13]中的加速比.

文献[12]使用判断某处是否为非零元素进行处理,相当于系数矩阵为满阵,本文采用此方872015,39(2)学术研究http://www.

aepsGinfo.

com法进行测试,结果如表6所示.

表中时间为不同运行环境下,执行一次暂态稳定计算所耗时长.

表6使用满阵时的测试结果Table6TestresultsbyusingfullGMatrix测试规模计算时间/msCPU串行计算GPU+满阵技术GPU+稀疏技术加速比39节点188810783281.

7578节点794827838882.

86从表6可以看出,结合满阵技术,在矩阵规模较小时已经能够有较高的加速比,但计算时间过长,远劣于应用稀疏技术时的结果,已经失去了加速的意义.

此外,当使用满阵时,用于CPU和GPU之间的数据同步时间将会大大地增加,表6及文献[12]结果均表明,超过50%的解方程组时间将用于数据同步.

当系统规模较大时,传输时间将增大到不可忍受的程度,且GPU将不足以一次性存下所有的数据.

满阵的研究成果不可直接用于电力系统计算分析,因此也造成了暂态稳定并行计算的加速比比满阵研究结果稍差.

3)在硬件环境上,本文的GTX570对双精度的支持并不好.

表7给出了CPU和GPU硬件特性比较[11].

表7典型的CPU和GPU的硬件特性Table7HardwarespecificationoftypicalCPUandGPU硬件型号核心数目浮点运算速度/(109次s-1)单精度双精度内存容量/GBInteli5G2320496488~16GTX57048014051751.

28Quadro600044810285146对于CPU,从单精度到双精度,浮点运算速度只下降了一半,但对于GTX570来说,下降为原来的1/8.

如果GTX570的双精度性能能够达到与CPU一样,为单精度的1/2,理论上本文的加速比可在现有基础上再提升2倍以上,达到7~8倍的加速比.

事实上,已经有高端的显卡Quadro6000能够做到这一点.

4)在理论上,直接法求解方程组的方法也制约了GPU的性能,在许多步骤上出现了"三角形问题",例如:假设需要对式(8)进行前代.

a=a11a21a22a31a32a33a41a42a43a44a51a52a53a54a55éêêêêêêêùúúúúúúú(8)完成对a11的归一化后,可开辟4个线程对第2至5行进行秩一修正;但对a44归一化后,仅能开辟1个线程对第5行进行修正,即某些时刻只有少数的线程进行计算.

由于单个CUDA核心的性能是远差于单个的CPU核心,因此这将会造成加速比的严重下降,拖累了整体的加速效果.

此问题覆盖了因子分解和前代回代的大部分步骤,造成加速比低于理论上限.

本文的研究结果表明,尽管存在一些瓶颈,但利用了GPU实现求解电力系统中线性方程组的直接法后,在电力系统暂态稳定计算中依然能够有较好的加速效果,目前的测试环境下能够达到3~4倍的加速.

当技术发展到目前高端水平的显卡能够普及时,加速比可望达到7~8倍.

4结语本文在分析电力系统计算中大规模线性方程组的稀疏特点后,提出了稀疏线性方程组直接求解法在GPU上的并行化实现方法,形成了粗粒度和细粒度的两层并行结构,分别利用GPU的线程块应用到电力系统计算中.

通过算例分析验证了方法的有效性.

分析结果表明,目前在一般配置的电脑上已有3~4倍的加速效果,优于GMRES等迭代法在GPU上的效率提升,且远低于理论的上限值,存在着较大的改进空间;当矩阵规模扩大时,加速比提升更为显著,具有良好的发展前景.

向上海交通大学国家能源智能电网(上海)研发中心提供良好的科研条件表示感谢.

附录见本刊网络版(http://www.

aepsGinfo.

com/aeps/ch/index.

aspx).

参考文献[1]吉兴全.

电力系统并行计算方法比较研究[J].

电网技术,2003,27(4):22G26.

JIXingquan.

Acomparativestudyonparallelprocessingappliedinpowersystem[J].

PowerSystemTechnology,2003,27(4):22G26.

[2]苏新民,毛承雄,陆继明.

对角块加边模型的并行潮流计算[J].

电网技术,2002,26(1):22G25.

SUXinmin,MAOChengxiong,LUJiming.

Parallelloadflowcalculationofblockborderedmodel[J].

PowerSystemTechnology,2002,26(1):22G25.

[3]赵文恺,房鑫炎,严正.

电力系统并行计算的嵌套分块对角加边形式划分算法[J].

中国电机工程学报,2010,30(25):66G73.

ZHAOWenkai,FANGXinyan,YANZheng.

NestedBBDFpartitioningalgorithminpowersystemparallelcomputation[J].

ProceedingsoftheCSEE,2010,30(25):66G73.

97周挺辉,等基于图形处理器的电力系统稀疏线性方程组求解方法[4]左墨.

电力系统暂态稳定及潮流计算的并行算法研究[D].

西安:陕西科技大学,2009.

[5]薛巍,舒继武,王心丰,等.

电力系统暂态稳定仿真并行算法的研究进展[J].

系统仿真学报,2002,14(2):177G182.

XUEWei,SHUJiwu,WANGXinfeng,etal.

Advanceofparallelalgorithmforpowersystemtransientstabilitysimulation[J].

JournalofSystemSimulation,2004,14(2):177G182.

[6]杨建林.

电力系统暂态稳定空间并行仿真[D].

天津:天津大学,2006.

[7]卢锦玲,于磊,朱永利.

PC机集群系统在电力系统暂态稳定分析中的应用[J].

华北电力大学学报,2006,32(2):25G28.

LUJinling,YULei,ZHUYongli.

ApplicationofPCclustersystemtotransientstabilityanalysisofelectricpowersystem[J].

JournalofNorthChinaElectricPowerUniversity,2006,32(2):25G28.

[8]周挺辉,严正,唐聪,等.

基于多核处理器技术的暂态稳定并行算法[J].

电力系统自动化,2013,37(8):70G75.

ZHOUTinghui,YANZheng,TANGCong,etal.

AparallelalgorithmfortransientstabilitycomputingbasedonmultiGcoreprocessortechnology[J].

AutomationofElectricPowerSystems,2013,37(8):70G75.

[9]江涵.

大规模电力系统暂态稳定并行计算研究[D].

杭州:浙江大学,2012.

[10]江涵,江全元.

基于GPU计算平台的大规模电力系统暂态稳定计算[J].

电力系统保护与控制,2013,41(4):13G20.

JIANGHan,JIANGQuanyuan.

AparalleltransientstabilityalgorithmforlargeGscalepowersystembasedonGPUplatform[J].

PowerSystemProtectionandControl,2013,41(4):13G20.

[11]唐聪,严正,周挺辉.

基于图形处理器的广义最小残差迭代法在电力系统暂态仿真中的应用[J].

电网技术,2013,37(5):1365G1371.

TANGCong,YANZheng,ZHOUTinghui.

ApplicationofgraphprocessingunitGbasedgeneralizedminimalresidualiterationinpowersystemtransientsimulation[J].

PowerSystemTechnology,2013,37(5):1365G1371.

[12]张宁宇,高山,赵欣.

基于GPU的机电暂态仿真细粒度并行算法[J].

电力系统自动化,2012,36(9):54G60.

ZHANGNingyu,GAOShan,ZHAOXin.

Afinegranularityparallelalgorithmforelectromechanicaltransientstabilitysimulationbasedongraphicprocessingunit[J].

AutomationofElectricPowerSystems,2012,36(9):54G60.

[13]TOMOVS,NATHR,LTAIEFH,etal.

DenselinearalgebrasolversformulticorewithGPUaccelerators[C]//24thIEEEInternationalSymposiumonParallelandDistributedProcessing(IPDPS2010),April19G23,2010,Atlanta,Georgia,USA.

[14]DUFFIS,DAVISTA.

UnsymmetricpatternmultifrontalmethodsforparallelsparseLUfactorization,technicalreportTRG91G23[R].

Florida,USA:UniversityofFlorida,1991.

[15]王锡凡,方万良,杜正春.

现代电力系统分析[M].

北京:科学出版社,2003.

[16]GOMEZA,FRANQUELOLG.

Anefficientorderingalgorithmtoimprovesparsevectormethods[J].

IEEETransonPowerSystems,1988,3(4):1538G1544.

周挺辉(1989—),男,通信作者,硕士,主要研究方向:电力系统高性能仿真.

EGmail:hancial@139.

com赵文恺(1983—),男,博士,主要研究方向:电力系统稳定计算、电力系统并行计算.

EGmail:zwk602@sjtu.

edu.

cn严正(1964—),男,教授,博士生导师,主要研究方向:电力系统动态分析与计算.

EGmail:yanz@sjtu.

edu.

cn(编辑顾晓荣)AMethodforSolvingSparseLinearEquationsofPowerSystemsBasedonGPUZHOUTinghui1ZHAOWenkai1YANZheng1XUDechao2JIANGHan21敭KeyLaboratoryofControlofPowerTransmissionandConversionShanghaiJiaoTongUniversityMinistryofEducationShanghai200240China2敭ChinaElectricPowerResearchInstituteBeijing100192ChinaAbstractInviewofthesparsityoflargeGscalesystemoflinearequationsofpowersystemsadirectmethodforsolvingthesparsesystemofequationsbasedongraphicsprocessingunitsGPUsisproposed敭InthismethodthecoefficientmatrixofequationsarepartitionedbytheorderingGfirstblockbordereddiagonalformBBDFpartitionmethodsothattwolevelsofparallelstructureareformedforsolvingthesparselinearequationswithBlocksandThreadsofGPUsinsuccession敭ThepartitionresultsareappliedtothepowersystemtransientstabilitycalculationandthespeedGupratioperformanceofthemethodproposedistested敭Thetestresultsshowthattheproposedmethodisabletoachievea3~4GfoldspeedGupratioincurrentlyuseddevicesandaprospective7~8GfoldspeedGupratiointhehighGenddevices敭ThisworkissupportedbyStateGridCorporationofChinaMajorProjectsonPlanningandOperationControlofLargeScaleGridNo敭SGCCGMPLG018G2012andSpecializedResearchFundfortheDoctoralProgramofHigherEducationSRFDPofChinaNo敭20120073110020敭KeywordspowersystemsparallelcomputationtransientstabilitycomputationgraphicsprocessingunitGPUsparsitytechnologyspeedGupratio082015,39(2)

电力传输与功率变换控制教育部重点实验室(上海交通大学),上海市200240;2.

中国电力科学研究院,北京市100192)摘要:针对电力系统大规模线性方程组的稀疏特点,提出了基于图形处理器(GPU)的直接求解方法.

该方法首先利用基于先排序的分块对角加边形式(BBDF)划分方法对方程组系数矩阵进行分割,形成具有粗粒度和细粒度两层并行结构的线性方程组,然后利用GPU的线程块和线程并行特性对其分别予以求解.

将上述方法应用到电力系统暂态稳定计算中,并对其加速效果进行了测试.

测试结果表明,在目前普及的设备上,所提方法可获得3~4倍的加速比;在高端设备上,能够获得7~8倍的加速比.

关键词:电力系统;并行计算;暂态稳定计算;图形处理器;稀疏技术;加速比收稿日期:2013G11G15;修回日期:2014G06G23.

国家电网公司大电网重大专项资助项目(SGCCGMPLG018G2012);高等学校博士学科点专项科研基金资助项目(20120073110020).

0引言现代电网运行工况复杂、难以预测.

为提高计算速度,单纯地采用简化模型或改进算法无法取得突破性进展[1],为此,并行计算成为了解决此类问题的有效途径之一.

大部分电力系统并行计算都是针对稀疏线性方程组进行的.

对于粗粒度并行结构而言,将线性方程组的系数矩阵划分为分块对角加边形式(BBDF),是提高并行计算效率的有效方法.

文献[2G3]先把电力系统分割为若干联系松散的区域,再对各区域进行并行计算.

文献[4G5]研究了电力系统潮流及暂态稳定计算的并行化方法.

文献[6G7]在个人计算机(PC)机群下利用上述算法实现了暂态稳定的并行计算,主要是对方程组的求解过程实现了多机的并行化,并获得了显著的加速效果.

近年来,多核CPU架构成为总体的发展趋势,文献[8]对此进行了研究,并在4核CPU机器上获得了3倍左右的加速效果.

并行体系架构的革新,使得把多个核心集成于同一块芯片上、以数量来弥补速度的不足成为可能.

多核CPU架构是其中的一种,众核图形处理器(GPU)架构是另一种.

统一计算设备架构(computeunifieddevicearchitecture,CUDA)的问世,使得GPU具备了通用计算的能力,为大型电力系统并行计算提供了新的途径.

文献[9G10]在CPUGGPU混合架构下,用稳定的双共轭梯度法实现了大型电力系统暂态稳定的超实时仿真计算.

文献[11]利用GPU以及广义最小残差方法(GMRES)实现了电力系统暂态稳定仿真计算,且在系统规模较大时取得了一定的成效.

文献[12]利用GPU实现了基于隐式梯形积分的机电暂态稳定仿真计算.

对于大规模稀疏线性方程组并行求解问题,若采用BBDF划分方法,则在众核GPU架构下,BBDF划分是否仍能够胜任细粒度的并行结构,需要进一步研究与探讨;若采用迭代法,虽然非常适合于众核GPU架构,但预处理的选择问题却很难解决;若采用直接法,则虽然不存在难收敛的问题,但在CPUGGPU混合架构下,如何处理方程组的稀疏性,又是一个值得研究的问题.

为了解决这2个问题,本文首先论证了先排序BBDF划分方法对于细粒度并行计算的可行性,其次,利用GPU的线程块(block)和线程(thread)并行特性,对具有粗/细粒度两层并行结构的线性方程组,提出了面向稀疏线性方程组的直接求解方法.

1众核GPU并行环境介绍NVIDIA公司在2007年推出了CUDA,使GPU能够用于图像处理以外的一般计算.

其与CPU主要的区别在于,CPU拥有较少的核心数目,47第39卷第2期2015年1月25日Vol.

39No.

2Jan.

25,2015DOI:10.

7500/AEPS20131115005http://www.

aepsGinfo.

com但功能强大;而GPU每个核心的处理能力不强,但一个芯片上能汇集众多的核心,如图1所示.

图1CPU和GPU的架构比较Fig.

1ArchitecturecomparisonofCPUandGPUCUDA技术的程序执行模型如图2所示[11],其从硬件上支持两层的并行结构:线程和线程块.

各个线程块间可以并行地执行,但相互之间不能高效地进行通信,可以形成粗粒度的并行.

而同一线程块内的不同线程可共享内存,实现线程间同步,形成细粒度的并行.

本文针对电力系统仿真计算的特点,研究基于线程块和线程上的并行,形成线程块间的粗粒度并行和线程间的细粒度并行.

图2中,线程块和线程均以2维予以展示,分别用Block(i,j)(i=0,1,2;j=0,1)和Thread(i,j)(i=0,1,2,3;j=0,1,2)表示.

但实际上采用1维、2维均可.

图2CUDA技术的程序执行模型Fig.

2ProgramexecutionmodelwithCUDAtechnology2电力系统仿真计算并行方案考虑到电力系统有其特殊的稀疏结构,因此,直接采用针对满阵的求解方法[13],抑或是基于稠密分块的多波前方法[14],都是不合适的.

本节以暂态稳定计算为例,对电力系统仿真计算的并行方案进行简要介绍后,给出了基于先排序的BBDF划分方法能够应用于粗/细粒度并行结构的依据,然后介绍了所提方法的原理和技术实现细节.

2.

1电力系统仿真计算的并行方案概述图3为用于暂态稳定计算的数学模型框架[15].

图3暂态稳定计算中系统数学模型框架Fig.

3Frameworkofsystemmodelintransientstabilitycalulation系统中的绝大部分动态元件都是相互独立的,仅通过电力网络连接形成统一的整体.

系统的数学模型可以描述为如下一般形式的微分—代数方程组:dxdt=f(x,y)(1)0=g(x,y)(2)式中:x为微分方程组中描述系统动态特性的状态变量;y为系统的代数变量.

常规解法有交替求解法和联立求解法.

本文采用的是交替迭代求解法.

但无论采取何种策略,在求解过程中都会形成大规模稀疏线性方程组,研究重点都是一致的(具体分析见附录A).

2.

2并行方案分析对于粗粒度并行计算,首先要将方程组的系数矩阵A划分为形如式(3)的BBDF[2G4,6,8].

A=A11A1cA22A2cAkkAkcAc1Ac2AckAccéêêêêêêêùúúúúúúú(3)式(3)的物理意义在于:将原始节点集合划分为若干互不关联的子集合和一个规模较小的联系节点集合(见图4).

其中,联系节点集合对应BBDF中的边界块Acc,各子集合对应BBDF中的对角块Aii,i=1,2,,k.

图4节点划分示意图Fig.

4Schematicdiagramofsystempartitioning一般观点认为,这种方法不适合于众核GPU.

其原因在于,为了能够充分利用GPU的众多核心,需要将节点集合分为数量足够多的子集合,这会导57周挺辉,等基于图形处理器的电力系统稀疏线性方程组求解方法致联系节点集合的规模急剧增大.

然而,对于先排序的BBDF划分,事实却并非如此,具体分析如下.

假设已采用了最小度最小深度(MDML)法[16]对所有节点进行了重排序.

由于所需要的子集合较多,故采用文献[8]提及的分区方法进行集合划分.

在多核CPU环境下,子集合的个数Q一般取为2至4.

但对于GPU来说,所需要的Q较大.

以3872条母线系统为例,测试不同分区数对联系节点集合的影响,如图5所示,具体数字参考附录B.

图5不同分区数目对联系节点集合的影响Fig.

5Effectofdifferentnumbersofpartitionsonlinkingsystem曲线符合对数特征.

对该曲线进行对数拟合后,得到以下结果:Y=-0.

307+0.

553ln(Q)(4)式中:Q为分区数;Y为联系节点集合所占百分比.

式(4)对图5曲线拟合程度较好,联系节点集合规模增加趋向平缓.

当分区数为64时,联系节点集合仅占2%.

因此,对大规模系统使用先排序BBDF方法将节点集合划分为几十个子集,是可行的.

2.

3暂态稳定并行计算的具体设计根据前文的研究,并将其应用到电力系统的暂态稳定分析中,可确定如下的计算方案:由CPU进行逻辑复杂的前期处理,在形成大规模稀疏方程组后,交由GPU进行方程的求解.

以交替求解法为例,算法流程如图6所示,联立求解法类似.

图6并行计算算法流程Fig.

6Flowchartofparallelalgorithm图6中解算网络方程的具体流程见图7.

图7(a)为CPU并行处理的流程,作为参考.

图7(b)为本文的研究,不同于CPU,其额外拥有两步"数据"处理的操作,其原因为CPU与GPU拥有不同的内存空间,需要对其数据进行同步处理.

图7CPU或GPU解方程组Fig.

7FlowchartofsolvingequationsonCPUorGPU对于非解方程部分,其并行化则相对较为简单.

由于各元件对系统的影响都较为独立,可以简单地分配到众多的核心中进行求解,具体参考附录C.

因此,仿真中并行化的难点在于前文重点分析的大规模稀疏线性方程组的求解.

本文在进行因子分解时,根据GPU的特点,制定出以下两层并行结构.

1)线程块层面的并行结构根据式(3),每个AiiAicAci0éêêùúú(i=1,2,,k)的因子分解相互独立,其可以交由GPU的多个线程块进行处理.

然而与文献[8]类似,此时由于每个线程块之间不能简单地交互数据,故暂时不能修正由每个Aii因子分解时对Acc的影响,而只修正了Aci和Aic.

此过程利用了GPU的线程块特性,实现了对方程组求解的粗粒度并行.

2)线程层面的并行结构在每个线程块的因子化过程中,可派生多个线程对其进行并行化,实现细粒度的并行.

为简单起见,以下面5阶的矩阵a为例说明.

a=a11a12a14a15a21a22a24a25a33a35a41a42a44a45a51a52a53a54a55éêêêêêêêùúúúúúúú(5)在第i步,包含归一化和秩一修正2个过程.

归一化过程:i=1时,需要对a12,a14,a15进行归一化,其相互是没有关联性的.

在实际操作过程当中,可以开辟32条线程.

当需要归一化的元素个数少于32个时,某些线程实质上不需要进行操作.

672015,39(2)学术研究http://www.

aepsGinfo.

com当元素个数多于32个时,某些线程会串行地对不止一个元素进行归一化.

下文开辟多线程也类似处理.

秩一修正过程:i=1时,实际上需要进行处理的元素是a22,a24,a25,a42,a44,a45,a52,a54,a55.

这些元素处于归一化时a12,a14,a15所在的列(第2,4,5列)与第2,4,5行的相交位置.

而其他位置的元素无论其是否非零元,均不会受到影响.

而需要修正的这些元素之间并不存在依赖关系,也可以实现线程级别的并行.

当i=1处理完毕时,以同样的策略处理i=2,3,,直到处理完毕所有的行.

此过程利用了GPU的线程特性,实现了对方程组求解的细粒度并行.

上述过程实现了对式(3)中各个子块的因子化.

当每个分块处理完毕后,需要对Acc进行修正:Acc,new=Acc,old-[Ac1Ac2Ack]A1cA2cAkcéêêêêêùúúúúú(6)Acc中的每个元素的修正均是独立的,可以同样地通过开辟多个线程进行处理.

Acc修正完毕后,需要对Acc,new进行因子化,过程与之前每个分块的方法一致,这里不再重复.

当因子化过程完成以后,进入前代回代过程.

与因子化过程一样,前代也可以形成两层的并行.

1)线程块层面的并行:式(3)的每个对角块交由GPU的一个线程块处理.

2)线程层面的并行:同样以式(5)为例,假设右端项为[b1,b2,b3,b4,b5]T.

当i=1时,首先对b1进行归一化处理,b2,b4,b5可以并行地进行修正.

当i=2时,对b2进行归一化处理,而后b4,b5可以并行地进行修正.

需要注意的是,此过程的修正仅针对Aii,i=1,2,,k;对于边界系统,需要额外处理.

上述过程完成后,需要研究[Ac1,Ac2,,Ack]对右端项的影响.

由于此矩阵中的第i行会且只会影响到右端项对应的bi,因此可为受到影响的每个bi开辟一个线程,进行并行处理.

回代过程与之类似.

因子化过程和前代回代过程分别见附录D图D1和图D2.

为了能够充分利用GPU的性能,实现过程中应尽量保证CUDA核心处于满负荷计算状态.

在图D1所示的过程中多线程块多线程区域,共开辟了32*k条线程同时执行.

在2.

2节中已经予以说明,k可以取为较大的数值,且保持联系节点集合的规模在可以接受的范围内.

若k>30,则32k>960,已经超过了CUDA核心的数目(本文测试环境GTX570为480个核心),足以给各个核心分配一定的计算量.

这也是即便要付出增加联系系统规模的代价下,也要划分众多子网的原因.

对于具体的某个CUDA核心,在某个分区不需要它的时候,可以由另外的分区进行调用,以消除等待时间.

由于GPU可以在不同线程间几乎零延时地进行切换(即一个CUDA核心可以在不同线程间来回切换,而不需要额外的时钟周期),因此较多的线程可以在一定程度上均衡CUDA核心的计算量.

综上所述,本文结合GPU运行环境实现了两层并行结构的方法,实现了大规模稀疏线性方程组在GPU中的求解,并应用到电力系统暂态稳定计算中.

3算例测试与分析3.

1仿真环境及技术指标本文使用VisualStudio2012作为开发环境,nVidiaCUDAToolkit5.

5作为GPU开发工具,采用C++及CUDA语言分别编写了运行于CPU上串行暂态计算程序和基于GPU的并行暂态计算程序.

两种程序采用相同算法框架,并且都应用稀疏存储技术,区别在于线性方程组求解过程是在CPU还是GPU上进行.

硬件平台如下:CPU为intelCorei52320/3GHz,内存8GB;GPU为nVidiaGeforceGTX570,运行环境MicrosoftWindows8.

1x64.

主要测试算例参数见表1,其中7800案例为利用IEEE300系统倍增26倍形成,7744系统为利用3872系统倍增形成.

初始潮流收敛且系统稳定.

微分方程采用改进欧拉法求解,代数方程采用高斯消元法直接求解,整体采用交替求解法.

故障设定为某母线出线端发生三相接地短路,延时切除故障.

计算步长为0.

005s,数据采用双精度.

表1测试案例参数Table1Parametersoftestcases测试案例母线数目支路数目发电机数目1056案例105613012703872案例387247889907744案例7744957719807800案例7800107861794本文主要考察程序进行并行化后的效率提升,并用式(7)所示的加速比技术指标来表示.

加速比=串行执行时间并行执行时间(7)77周挺辉,等基于图形处理器的电力系统稀疏线性方程组求解方法3.

2计算结果与分析3.

2.

1计算参数设置及结果由于在GPU上可调参数较多,例如分区个数、GPU上开辟的线程块数目、每个线程块内的线程数等均可调整,因此本文首先通过一系列的测试,确定参数的设置,具体设置见附录D.

对于多线程块多线程区域每个线程块开辟32条线程、单线程块多线程区域开辟1024条线程能够获得最优的加速效果.

在此基础上,表2显示了不同分区数对结果的影响.

表2不同分区数的测试结果Table2Testresultsofdifferentnumbersofpartitioning分区数执行时间/ms分区数执行时间/ms分区数执行时间/ms417921165021642391613200204381801877888172434169626421078773229241282803126144482717由于本文的设定为一个分区(即一个对角块)由GPU的一个线程块进行处理,因此表中的结果也即为线程块个数的设定.

对多个案例测试的经验结果表明,分区个数Q=0.

8~0.

9N(N为方程的总维数)时能够获得最优的效果.

此时,每个分区的维数约为1.

1N.

在上述设置下,联系系统的规模与各个子网的规模相差不大,前者约为单个后者的80%~90%.

测试中发现,联系系统的运算时间(包括各个子网对联系系统的修正过程)大约为全部子网运算时间的50%~60%,比重较大,因此再继续增大联系系统的规模就会影响并行效率.

根据以上结果,本文对测试案例进行分区时主要采取的设置参数如表3所示.

表3分区参数设置Table3Parametersettingsinpartitioning测试案例母线数分区个数指导阈值1056案例105640453872案例387270907744案例77441001407800案例7800100140注:指导阈值为文献[8]分区方法的参数设置,即前驱节点数超过此值的节点,直接纳入到联系系统.

本文使用微软的VC编译器和英伟达的NVCC编译器分别进行了测试,结果如表4和表5所示.

表4中,"GPU"指图7中由GPU进行的部分内容,其中包括了数据同步部分(即表5中的通信部分);"CPU"表示图7(a)部分内容,形成了与GPU部分的对照程序;"共同"则表示图6中为除网络方程求解外的其他内容,GPU程序和CPU对照程序均使用此部分内容,在计算加速比时将扣除此共同时间后再予以比较.

表4CPU和GPU对比测试结果Table4ComparativetestresultsonCPUandGPU测试案例执行时间/msCPU部分+共同部分GPU部分+共同部分共同部分加速比1056案例135411844211.

223872案例9336448218012.

817744案例423216247063.

847800案例423016327173.

84注:①四个案例仿真的总时长不一样,不可横向比较;②共同及CPU部分由VC编译,GPU部分由NVCC编译.

表5GPU部分通信占据测试结果Table5TestresultsofcommunicationsonGPU测试案例GPU部分执行时间/ms通信时间/ms通信占比/%加速比1056案例75941554.

72.

683872案例2681140752.

55.

917744案例91847852.

18.

017800案例91548052.

48.

07注:GPU部分扣除了通信时间.

从表4的结果可以看出,随着系统规模的增大,加速比的效率也随之增加,目前规模下可达3.

84;在同等矩阵规模下,已经明显优于使用广义最小残差迭代法(GMRES)结合GPU所带来的加速比[11].

表5给出了各个案例下数据同步(即CPU、GPU内存间通信)所占据时间的比例,一般在50%~60%左右.

若扣除此部分时间,只考察GPU和CPU在解稀疏方程组的加速效果,加速比则能够达到8以上.

但在应用过程中,同步时间是必要的,表4的数据更具参考价值.

3.

2.

2计算结果分析结合理论方法以及测试结果,具体分析如下所示.

1)经过预处理后,矩阵形成如式(3)所示的形式;为每个对角块分配一个线程块,同时为每个线程块分配了32个线程,形成了两层的并行结构.

结合稀疏技术后,每个CUDA核心仍可以满负荷地运行,充分发挥了GPU的性能,并获得了良好的效果.

而在联系节点集合的处理上,由于其相对比较稠密,根据文献[13],也能够有效发挥GPU的作用.

2)本文最大的加速比为3.

84,小于文献[12G13]中的加速比.

文献[12]使用判断某处是否为非零元素进行处理,相当于系数矩阵为满阵,本文采用此方872015,39(2)学术研究http://www.

aepsGinfo.

com法进行测试,结果如表6所示.

表中时间为不同运行环境下,执行一次暂态稳定计算所耗时长.

表6使用满阵时的测试结果Table6TestresultsbyusingfullGMatrix测试规模计算时间/msCPU串行计算GPU+满阵技术GPU+稀疏技术加速比39节点188810783281.

7578节点794827838882.

86从表6可以看出,结合满阵技术,在矩阵规模较小时已经能够有较高的加速比,但计算时间过长,远劣于应用稀疏技术时的结果,已经失去了加速的意义.

此外,当使用满阵时,用于CPU和GPU之间的数据同步时间将会大大地增加,表6及文献[12]结果均表明,超过50%的解方程组时间将用于数据同步.

当系统规模较大时,传输时间将增大到不可忍受的程度,且GPU将不足以一次性存下所有的数据.

满阵的研究成果不可直接用于电力系统计算分析,因此也造成了暂态稳定并行计算的加速比比满阵研究结果稍差.

3)在硬件环境上,本文的GTX570对双精度的支持并不好.

表7给出了CPU和GPU硬件特性比较[11].

表7典型的CPU和GPU的硬件特性Table7HardwarespecificationoftypicalCPUandGPU硬件型号核心数目浮点运算速度/(109次s-1)单精度双精度内存容量/GBInteli5G2320496488~16GTX57048014051751.

28Quadro600044810285146对于CPU,从单精度到双精度,浮点运算速度只下降了一半,但对于GTX570来说,下降为原来的1/8.

如果GTX570的双精度性能能够达到与CPU一样,为单精度的1/2,理论上本文的加速比可在现有基础上再提升2倍以上,达到7~8倍的加速比.

事实上,已经有高端的显卡Quadro6000能够做到这一点.

4)在理论上,直接法求解方程组的方法也制约了GPU的性能,在许多步骤上出现了"三角形问题",例如:假设需要对式(8)进行前代.

a=a11a21a22a31a32a33a41a42a43a44a51a52a53a54a55éêêêêêêêùúúúúúúú(8)完成对a11的归一化后,可开辟4个线程对第2至5行进行秩一修正;但对a44归一化后,仅能开辟1个线程对第5行进行修正,即某些时刻只有少数的线程进行计算.

由于单个CUDA核心的性能是远差于单个的CPU核心,因此这将会造成加速比的严重下降,拖累了整体的加速效果.

此问题覆盖了因子分解和前代回代的大部分步骤,造成加速比低于理论上限.

本文的研究结果表明,尽管存在一些瓶颈,但利用了GPU实现求解电力系统中线性方程组的直接法后,在电力系统暂态稳定计算中依然能够有较好的加速效果,目前的测试环境下能够达到3~4倍的加速.

当技术发展到目前高端水平的显卡能够普及时,加速比可望达到7~8倍.

4结语本文在分析电力系统计算中大规模线性方程组的稀疏特点后,提出了稀疏线性方程组直接求解法在GPU上的并行化实现方法,形成了粗粒度和细粒度的两层并行结构,分别利用GPU的线程块应用到电力系统计算中.

通过算例分析验证了方法的有效性.

分析结果表明,目前在一般配置的电脑上已有3~4倍的加速效果,优于GMRES等迭代法在GPU上的效率提升,且远低于理论的上限值,存在着较大的改进空间;当矩阵规模扩大时,加速比提升更为显著,具有良好的发展前景.

向上海交通大学国家能源智能电网(上海)研发中心提供良好的科研条件表示感谢.

附录见本刊网络版(http://www.

aepsGinfo.

com/aeps/ch/index.

aspx).

参考文献[1]吉兴全.

电力系统并行计算方法比较研究[J].

电网技术,2003,27(4):22G26.

JIXingquan.

Acomparativestudyonparallelprocessingappliedinpowersystem[J].

PowerSystemTechnology,2003,27(4):22G26.

[2]苏新民,毛承雄,陆继明.

对角块加边模型的并行潮流计算[J].

电网技术,2002,26(1):22G25.

SUXinmin,MAOChengxiong,LUJiming.

Parallelloadflowcalculationofblockborderedmodel[J].

PowerSystemTechnology,2002,26(1):22G25.

[3]赵文恺,房鑫炎,严正.

电力系统并行计算的嵌套分块对角加边形式划分算法[J].

中国电机工程学报,2010,30(25):66G73.

ZHAOWenkai,FANGXinyan,YANZheng.

NestedBBDFpartitioningalgorithminpowersystemparallelcomputation[J].

ProceedingsoftheCSEE,2010,30(25):66G73.

97周挺辉,等基于图形处理器的电力系统稀疏线性方程组求解方法[4]左墨.

电力系统暂态稳定及潮流计算的并行算法研究[D].

西安:陕西科技大学,2009.

[5]薛巍,舒继武,王心丰,等.

电力系统暂态稳定仿真并行算法的研究进展[J].

系统仿真学报,2002,14(2):177G182.

XUEWei,SHUJiwu,WANGXinfeng,etal.

Advanceofparallelalgorithmforpowersystemtransientstabilitysimulation[J].

JournalofSystemSimulation,2004,14(2):177G182.

[6]杨建林.

电力系统暂态稳定空间并行仿真[D].

天津:天津大学,2006.

[7]卢锦玲,于磊,朱永利.

PC机集群系统在电力系统暂态稳定分析中的应用[J].

华北电力大学学报,2006,32(2):25G28.

LUJinling,YULei,ZHUYongli.

ApplicationofPCclustersystemtotransientstabilityanalysisofelectricpowersystem[J].

JournalofNorthChinaElectricPowerUniversity,2006,32(2):25G28.

[8]周挺辉,严正,唐聪,等.

基于多核处理器技术的暂态稳定并行算法[J].

电力系统自动化,2013,37(8):70G75.

ZHOUTinghui,YANZheng,TANGCong,etal.

AparallelalgorithmfortransientstabilitycomputingbasedonmultiGcoreprocessortechnology[J].

AutomationofElectricPowerSystems,2013,37(8):70G75.

[9]江涵.

大规模电力系统暂态稳定并行计算研究[D].

杭州:浙江大学,2012.

[10]江涵,江全元.

基于GPU计算平台的大规模电力系统暂态稳定计算[J].

电力系统保护与控制,2013,41(4):13G20.

JIANGHan,JIANGQuanyuan.

AparalleltransientstabilityalgorithmforlargeGscalepowersystembasedonGPUplatform[J].

PowerSystemProtectionandControl,2013,41(4):13G20.

[11]唐聪,严正,周挺辉.

基于图形处理器的广义最小残差迭代法在电力系统暂态仿真中的应用[J].

电网技术,2013,37(5):1365G1371.

TANGCong,YANZheng,ZHOUTinghui.

ApplicationofgraphprocessingunitGbasedgeneralizedminimalresidualiterationinpowersystemtransientsimulation[J].

PowerSystemTechnology,2013,37(5):1365G1371.

[12]张宁宇,高山,赵欣.

基于GPU的机电暂态仿真细粒度并行算法[J].

电力系统自动化,2012,36(9):54G60.

ZHANGNingyu,GAOShan,ZHAOXin.

Afinegranularityparallelalgorithmforelectromechanicaltransientstabilitysimulationbasedongraphicprocessingunit[J].

AutomationofElectricPowerSystems,2012,36(9):54G60.

[13]TOMOVS,NATHR,LTAIEFH,etal.

DenselinearalgebrasolversformulticorewithGPUaccelerators[C]//24thIEEEInternationalSymposiumonParallelandDistributedProcessing(IPDPS2010),April19G23,2010,Atlanta,Georgia,USA.

[14]DUFFIS,DAVISTA.

UnsymmetricpatternmultifrontalmethodsforparallelsparseLUfactorization,technicalreportTRG91G23[R].

Florida,USA:UniversityofFlorida,1991.

[15]王锡凡,方万良,杜正春.

现代电力系统分析[M].

北京:科学出版社,2003.

[16]GOMEZA,FRANQUELOLG.

Anefficientorderingalgorithmtoimprovesparsevectormethods[J].

IEEETransonPowerSystems,1988,3(4):1538G1544.

周挺辉(1989—),男,通信作者,硕士,主要研究方向:电力系统高性能仿真.

EGmail:hancial@139.

com赵文恺(1983—),男,博士,主要研究方向:电力系统稳定计算、电力系统并行计算.

EGmail:zwk602@sjtu.

edu.

cn严正(1964—),男,教授,博士生导师,主要研究方向:电力系统动态分析与计算.

EGmail:yanz@sjtu.

edu.

cn(编辑顾晓荣)AMethodforSolvingSparseLinearEquationsofPowerSystemsBasedonGPUZHOUTinghui1ZHAOWenkai1YANZheng1XUDechao2JIANGHan21敭KeyLaboratoryofControlofPowerTransmissionandConversionShanghaiJiaoTongUniversityMinistryofEducationShanghai200240China2敭ChinaElectricPowerResearchInstituteBeijing100192ChinaAbstractInviewofthesparsityoflargeGscalesystemoflinearequationsofpowersystemsadirectmethodforsolvingthesparsesystemofequationsbasedongraphicsprocessingunitsGPUsisproposed敭InthismethodthecoefficientmatrixofequationsarepartitionedbytheorderingGfirstblockbordereddiagonalformBBDFpartitionmethodsothattwolevelsofparallelstructureareformedforsolvingthesparselinearequationswithBlocksandThreadsofGPUsinsuccession敭ThepartitionresultsareappliedtothepowersystemtransientstabilitycalculationandthespeedGupratioperformanceofthemethodproposedistested敭Thetestresultsshowthattheproposedmethodisabletoachievea3~4GfoldspeedGupratioincurrentlyuseddevicesandaprospective7~8GfoldspeedGupratiointhehighGenddevices敭ThisworkissupportedbyStateGridCorporationofChinaMajorProjectsonPlanningandOperationControlofLargeScaleGridNo敭SGCCGMPLG018G2012andSpecializedResearchFundfortheDoctoralProgramofHigherEducationSRFDPofChinaNo敭20120073110020敭KeywordspowersystemsparallelcomputationtransientstabilitycomputationgraphicsprocessingunitGPUsparsitytechnologyspeedGupratio082015,39(2)

- 基于图形处理器的电力系统稀疏线性方程组求解方法相关文档

- 转子稳定空间

- 位置稳定空间

- 偏差稳定空间

- 装配式钢结构建筑质量管理导则

- 先锋派的哲学追求及影视艺术之后现代症状

- 答案稳定空间

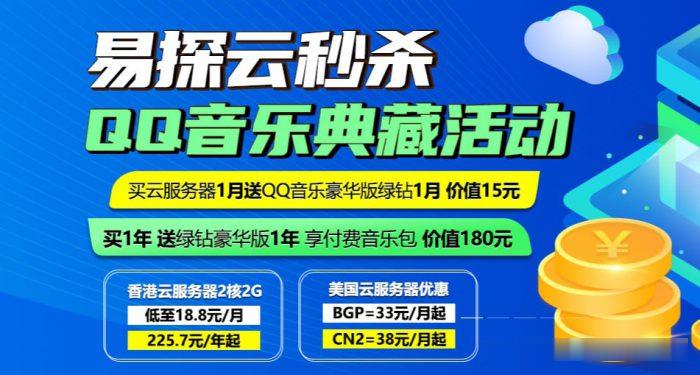

哪里购买香港云服务器便宜?易探云2核2G低至18元/月起;BGP线路年付低至6.8折

哪里购买香港云服务器便宜?众所周知,国内购买云服务器大多数用户会选择阿里云或腾讯云,但是阿里云香港云服务器不仅平时没有优惠,就连双十一、618、开年采购节这些活动也很少给出优惠。那么,腾讯云虽然海外云有优惠活动,但仅限新用户,购买过腾讯云服务器的用户就不会有优惠了。那么,我们如果想买香港云服务器,怎么样购买香港云服务器便宜和优惠呢?下面,云服务器网(yuntue.com)小编就介绍一下!我们都知道...

易探云美国云服务器评测,主机低至33元/月,336元/年

美国服务器哪家平台好?美国服务器无需备案,即开即用,上线快。美国服务器多数带防御,且有时候项目运营的时候,防御能力是用户考虑的重点,特别是网站容易受到攻击的行业。现在有那么多美国一年服务器,哪家的美国云服务器好呢?美国服务器用哪家好?这里推荐易探云,有美国BGP、美国CN2、美国高防、美国GIA等云服务器,线路优化的不错。易探云刚好就是做香港及美国云服务器的主要商家之一,我们来看一下易探云美国云服...

PQ.hosting:香港HE/乌克兰/俄罗斯/荷兰/摩尔多瓦/德国/斯洛伐克/捷克vps,2核/2GB内存/30GB NVMe空间,€3/月

PQ.hosting怎么样?PQ.hosting是一家俄罗斯商家,正规公司,主要提供KVM VPS和独立服务器,VPS数据中心有香港HE、俄罗斯莫斯科DataPro、乌克兰VOLIA、拉脱维亚、荷兰Serverius、摩尔多瓦Alexhost、德国等。部分配置有变化,同时开通Paypal付款。香港、乌克兰、德国、斯洛伐克、捷克等为NVMe硬盘。香港为HE线路,三网绕美(不太建议香港)。免费支持wi...

稳定空间为你推荐

-

服务器空间租用网站服务器是租用好,还是购买服务器好,还是购买空间好..广东虚拟主机广东哪里可以购买教育网虚拟主机?asp主机asp.net虚拟主机怎么样,它和asp虚拟主机是不是一样的,求解释已备案域名查询如何查询已备案的域名是否在万网备案的?重庆虚拟空间重庆虚拟主机租用那家好?网站空间商网站空间商怎么查询山东虚拟主机山东东营制作网站的公司在哪里?jsp虚拟主机jsp中文网的虚拟主机有人用过没?觉得怎么样?安徽虚拟主机合肥蜀山区哪家网络公司做网站最好四川虚拟主机四川java虚拟主机,哪里比较好