spidertxt用Google网站管理员工具提醒我的网站受到robots.txt文件限制是怎么回事?

robots.txt文件无内容 放入主目录会影响收录吗

如果文件无内容,也表示允许所有的蜘蛛访问

robots.txt是搜索引擎中访问网站的时候要查看的第一个文件。

Robots.txt文件告诉蜘蛛程序在服务器上什么文件是可以被查看的。

当一个搜索蜘蛛访问一个站点时,它会首先检查该站点根目录下是否存在robots.txt,如果存在,搜索机器人就会按照该文件中的内容来确定访问的范围;如果该文件不存在,所有的搜索蜘蛛将能够访问网站上所有没有被口令保护的页面。

robots.txt必须放置在一个站点的根目录下,而且文件名必须全部小写。

语法:最简单的 robots.txt 文件使用两条规则:

? User-Agent: 适用下列规则的漫游器

? Disallow: 要拦截的网页

搜索引擎Robots协议,是放置在网站根目录下robots.txt文本文件,在文件中可以设定搜索引擎蜘蛛爬行规则。

设置搜索引擎蜘蛛Spider抓取内容规则。

下面Seoer惜缘举例robots写法规则与含义:

首先要创建一个robots.txt文本文件,放置网站的根目录下,下面就开始编辑设置Robots协议文件:

一、允许所有搜索引擎蜘蛛抓取所以目录文件,如果文件无内容,也表示允许所有的蜘蛛访问,设置代码如下:

User-agent: *

Disallow:

或者

User-agent: *

Allow: /

二、禁止某个搜索引擎蜘蛛抓取目录文件,设置代码如下: User-agent: Msnbot Disallow: /

User-agent: Msnbot

Disallow: /

例如想禁止MSN的蜘蛛抓取就设为,Msnbot代表MSN的蜘蛛,如果想禁止其他搜索引擎就更换蜘蛛名字即可,其他蜘蛛名字如下:

百度的蜘蛛:baiduspider

Google的蜘蛛: Googlebot

腾讯Soso:Sosospider

Yahoo的蜘蛛:Yahoo Slurp

Msn的蜘蛛:Msnbot

Altavista的蜘蛛:Scooter

Lycos的蜘蛛: Lycos_Spider_(T-Rex)

三、禁止某个目录被搜索引擎蜘蛛抓取,设置代码如下:

User-agent: *

Disallow: /目录名字1/

Disallow: /目录名字2/

Disallow: /目录名字3/

把目录名字改为你想要禁止的目录即可禁止搜索引擎蜘蛛抓取,目录名字未写表示可以被搜索引擎抓取。

四、禁止某个目录被某个搜索引擎蜘蛛抓取,设置代码如下:

User-agent: 搜索引擎蜘蛛名字 说明(上面有说明蜘蛛的名字)Disallow: /目录名字/ 说明(这里设定禁止蜘蛛抓取的目录名称)例如,想禁目Msn蜘蛛抓取admin文件夹,可以设代码如下:

User-agent: Msnbot

Disallow: /admin/

五、设定某种类型文件禁止被某个搜索引擎蜘蛛抓取,设置代码如下:

User-agent: *

Disallow: /*.htm 说明(其中“.htm”,表示禁止搜索引擎蜘蛛抓取所有“htm”为后缀的文件)

六、充许所有搜索引擎蜘蛛访问以某个扩展名为后缀的网页地址被抓取,设置代码如下:

User-agent: *

Allow: .htm$ 说明(其中“.htm”,表示充许搜索引擎蜘蛛抓取所有“htm”为后缀的文件)

七、只充许某个搜索引擎蜘蛛抓取目录文件,设置代码如下:

User-agent: 搜索引擎蜘蛛名字 说明(上面有说明蜘蛛的名字)

Disallow:

什么是robots.txt?什么是"网址受到 robots.txt 的限制"错误

什么是robots.txt文件:搜索引擎通过一种爬虫spider程序(又称搜索蜘蛛、robot、搜索机器人等),自动搜集互联网上的网页并获取相关信息。鉴于网络安全与隐私的考虑,搜索引擎遵循robots.txt协议。

通过根目录中创建的纯文本文件robots.txt,网站可以声明不想被robots访问的部分。

每个网站都可以自主控制网站是否愿意被搜索引擎收录,或者指定搜索引擎只收录指定的内容。

当一个搜索引擎的爬虫访问一个站点时,它会首先检查该站点根目录下是否存在robots.txt,如果该文件不存在,那么爬虫就沿着链接抓取,如果存在,爬虫就会按照该文件中的内容来确定访问的范围。

什么是robots.txt文件?

Robots协议(也称为爬虫协议、机器人协议等)的全称是“网络爬虫排除标准”(Robots Exclusion Protocol),网站通过Robots协议告诉搜索引擎哪些页面可以抓取,哪些页面不能抓取。robots.txt文件是一个文本文件,使用任何一个常见的文本编辑器,比如Windows系统自带的Notepad,就可以创建和编辑它[1]。

robots.txt是一个协议,而不是一个命令。

robots.txt是搜索引擎中访问网站的时候要查看的第一个文件。

robots.txt文件告诉蜘蛛程序在服务器上什么文件是可以被查看的。

当一个搜索蜘蛛访问一个站点时,它会首先检查该站点根目录下是否存在robots.txt,如果存在,搜索机器人就会按照该文件中的内容来确定访问的范围;如果该文件不存在,所有的搜索蜘蛛将能够访问网站上所有没有被口令保护的页面。

百度官方建议,仅当您的网站包含不希望被搜索引擎收录的内容时,才需要使用robots.txt文件。

如果您希望搜索引擎收录网站上所有内容,请勿建立robots.txt文件。

如果将网站视为酒店里的一个房间,robots.txt就是主人在房间门口悬挂的“请勿打扰”或“欢迎打扫”的提示牌。

这个文件告诉来访的搜索引擎哪些房间可以进入和参观,哪些房间因为存放贵重物品,或可能涉及住户及访客的隐私而不对搜索引擎开放。

但robots.txt不是命令,也不是防火墙,如同守门人无法阻止窃贼等恶意闯入者。

功能 Robots协议用来告知搜索引擎哪些页面能被抓取,哪些页面不能被抓取;可以屏蔽一些网站中比较大的文件,如:图片,音乐,视频等,节省服务器带宽;可以屏蔽站点的一些死链接。

方便搜索引擎抓取网站内容;设置网站地图连接,方便引导蜘蛛爬取页面。

文件写法 User-agent: * 这里的*代表的所有的搜索引擎种类,*是一个通配符 Disallow: /admin/ 这里定义是禁止爬寻admin目录下面的目录 Disallow: /require/ 这里定义是禁止爬寻require目录下面的目录 Disallow: /ABC/ 这里定义是禁止爬寻ABC目录下面的目录 Disallow: /cgi-bin/*.htm 禁止访问/cgi-bin/目录下的所有以".htm"为后缀的URL(包含子目录)。

Disallow: /*?* 禁止访问网站中所有包含问号 (?) 的网址 Disallow: /.jpg$ 禁止抓取网页所有的.jpg格式的图片 Disallow:/ab/adc.html 禁止爬取ab文件夹下面的adc.html文件。

Allow: /cgi-bin/ 这里定义是允许爬寻cgi-bin目录下面的目录 Allow: /tmp 这里定义是允许爬寻tmp的整个目录 Allow: .htm$ 仅允许访问以".htm"为后缀的URL。

Allow: .gif$ 允许抓取网页和gif格式图片 Sitemap: 网站地图 告诉爬虫这个页面是网站地图 文件用法 例1. 禁止所有搜索引擎访问网站的任何部分 User-agent: * Disallow: / 实例分析:淘宝网的 Robots.txt文件 User-agent: Baiduspider Disallow: / User-agent: baiduspider Disallow: / 很显然淘宝不允许百度的机器人访问其网站下其所有的目录。

例2. 允许所有的robot访问 (或者也可以建一个空文件 “/robots.txt” file) User-agent: * Allow: / 例3. 禁止某个搜索引擎的访问 User-agent: BadBot Disallow: / 例4. 允许某个搜索引擎的访问 User-agent: Baiduspider allow:/ 例5.一个简单例子 在这个例子中,该网站有三个目录对搜索引擎的访问做了限制,即搜索引擎不会访问这三个目录。

需要注意的是对每一个目录必须分开声明,而不要写成 “Disallow: /cgi-bin/ /tmp/”。

User-agent:后的*具有特殊的含义,代表“any robot”,所以在该文件中不能有“Disallow: /tmp/*” or “Disallow:*.gif”这样的记录出现。

User-agent: * Disallow: /cgi-bin/ Disallow: /tmp/ Disallow: /~joe/ Robot特殊参数: 允许 Googlebot: 如果您要拦截除Googlebot以外的所有漫游器不能访问您的网页,可以使用下列语法: User-agent: Disallow: / User-agent: Googlebot Disallow: Googlebot 跟随指向它自己的行,而不是指向所有漫游器的行。

“Allow”扩展名: Googlebot 可识别称为“Allow”的 robots.txt 标准扩展名。

其他搜索引擎的漫游器可能无法识别此扩展名,因此请使用您感兴趣的其他搜索引擎进行查找。

“Allow”行的作用原理完全与“Disallow”行一样。

只需列出您要允许的目录或页面即可。

您也可以同时使用“Disallow”和“Allow”。

例如,要拦截子目录中某个页面之外的其他所有页面,可以使用下列条目: User-agent: Googlebot Allow: /folder1/myfile.html Disallow: /folder1/ 这些条目将拦截 folder1 目录内除 myfile.html 之外的所有页面。

如果您要拦截 Googlebot 并允许 Google 的另一个漫游器(如 Googlebot-Mobile),可使用”Allow”规则允许该漫游器的访问。

例如: User-agent: Googlebot Disallow: / User-agent: Googlebot-Mobile Allow: 使用 * 号匹配字符序列: 您可使用星号 (*) 来匹配字符序列。

例如,要拦截对所有以 private 开头的子目录的访问,可使用下列条目: User-Agent: Googlebot Disallow: /private*/ 要拦截对所有包含问号 (?) 的网址的访问,可使用下列条目: User-agent: * Disallow: /*?* 使用 $ 匹配网址的结束字符 您可使用 $字符指定与网址的结束字符进行匹配。

例如,要拦截以 .asp 结尾的网址,可使用下列条目: User-agent: Googlebot Disallow: /*.asp$ 您可将此模式匹配与 Allow 指令配合使用。

例如,如果 ? 表示一个会话 ID,您可排除所有包含该 ID 的网址,确保 Googlebot 不会抓取重复的网页。

但是,以 ? 结尾的网址可能是您要包含的网页版本。

在此情况下,可对 robots.txt 文件进行如下设置: User-agent: * Allow: /*?$ Disallow: /*? Disallow: / *? 一行将拦截包含 ? 的网址(具体而言,它将拦截所有以您的域名开头、后接任意字符串,然后是问号 (?),而后又是任意字符串的网址)。

Allow: /*?$ 一行将允许包含任何以 ? 结尾的网址(具体而言,它将允许包含所有以您的域名开头、后接任意字符串,然后是问号 (?),问号之后没有任何字符的网址)。

尽管robots.txt已经存在很多年了,但是各大搜索引擎对它的解读都有细微差别。

Google与百度都分别在自己的站长工具中提供了robots工具。

如果您编写了robots.txt文件,建议您在这两个工具中都进行测试,因为这两者的解析实现确实有细微差别[1]。

其它属性 1. Robot-version: 用来指定robot协议的版本号 例子: Robot-version: Version 2.0 2.Crawl-delay:雅虎YST一个特定的扩展名,可以通过它对我们的抓取程序设定一个较低的抓取请求频率。

您可以加入Crawl-delay:xx指示,其中,“XX”是指在crawler程序两次进入站点时,以秒为单位的最低延时。

3. Visit-time:只有在visit-time指定的时间段里,robot才可以访问指定的URL,否则不可访问. 例子: Visit-time: 0100-1300 #允许在凌晨1:00到13:00访问 4. Request-rate: 用来限制URL的读取频率 例子: Request-rate: 40/1m 0100 - 0759 在1:00到07:59之间,以每分钟40次的频率进行访问 Request-rate: 12/1m 0800 - 1300 在8:00到13:00之间,以每分钟12次的频率进行访问 标签 Robots.txt文件主要是限制整个站点或者目录的搜索引擎访问情况,而Robots Meta标签则主要是针对一个个具体的页面。

和其他的META标签(如使用的语言、页面的描述、关键词等)一样,Robots Meta标签也是放在页面中,专门用来告诉搜索引擎ROBOTS如何抓取该页的内容。

Robots Meta标签中没有大小写之分,name=”Robots”表示所有的搜索引擎,可以针对某个具体搜索引擎写为name=”BaiduSpider”。

content部分有四个指令选项:index、noindex、follow、nofollow,指令间以“,”分隔。

index指令告诉搜索机器人抓取该页面; follow指令表示搜索机器人可以沿着该页面上的链接继续抓取下去; Robots Meta标签的缺省值是index和follow,只有inktomi除外,对于它,缺省值是index、nofollow。

注意事项 上述的robots.txt和Robots Meta标签限制搜索引擎机器人(ROBOTS)抓取站点内容的办法只是一种规则,需要搜索引擎机器人的配合才行,并不是每个ROBOTS都遵守的。

目前看来,绝大多数的搜索引擎机器人都遵守robots.txt的规则,而对于Robots META标签,支持的并不多,但是正在逐渐增加,如著名搜索引擎GOOGLE就完全支持,而且GOOGLE还增加了一个指令“archive”,可以限制GOOGLE是否保留网页快照。

为什么我的网站已经添加robots.txt,还能在搜搜网页中被搜索到?

在robots.txt中添加了禁止访问的规则后,sosospider即会遵循按规则停止相应的页面/站点抓取。

但是,因为搜索引擎索引数据库的索引更新需要时间,所以在二至四周后,这些页面/站点才会从搜搜网页搜索引擎的结果中消失。

sosospider在robots.txt中的名字是什么?

即是“Sosospider。

”。

首字母S大写,其余为小写。

用Google网站管理员工具提醒我的网站受到robots.txt文件限制是怎么回事?

Robots.txt 带来的好处: 1. 几乎所有的搜索引擎 Spider 都遵循 robots.txt 给出的爬行规则,协议规定搜索引擎 Spider 进 入某个网站的入口即是该网站的 robots.txt,当然,前提是该网站存在此文件。对于没有配置robots.txt 的网站,Spider 将会被重定向至 404 错误页面,相关研究表明,如果网站采用了自定义的 404 错误页面,那么 Spider 将会把其视作 robots.txt——虽然其并非一个纯粹的文本文件——这将给 Spider 索引网站带来很大的困扰,影响搜索引擎对网站页面的收录。

2. robots.txt 可以制止不必要的搜索引擎占用服务器的宝贵带宽,如 email retrievers,这类搜索 引擎对大多数网站是没有意义的;再如 image strippers,对于大多数非图形类网站来说其也没有太大意义,但却耗用大量带宽。

3. robots.txt 可以制止搜索引擎对非公开页面的爬行与索引,如网站的后台程序、管理程序,事实上,对于某些在运行中产生临时页面的网站来说,如果未配置 robots.txt,搜索引擎甚至会索引那些临时文件。

4. 对于内容丰富、存在很多页面的网站来说,配置 robots.txt 的意义更为重大,因为很多时候 其会遭遇到搜索引擎 Spider 给予网站的巨大压力:洪水般的 Spider 访问,如果不加控制,甚至会影响网站的正常访问。

5. 同样地,如果网站内存在重复内容,使用 robots.txt 限制部分页面不被搜索引擎索引和收录,可以避免网站受到搜索引擎关于 duplicate content 的惩罚,保证网站的排名不受影响。

robots.txt 带来的风险及解决: 1. 凡事有利必有弊,robots.txt 同时也带来了一定的风险:其也给攻击者指明了网站的目录结构和私密数据所在的位置。

虽然在 Web 服务器的安全措施配置得当的前提下这不是一个严重 的问题,但毕竟降低了那些不怀好意者的攻击难度。

比如说,如果网站中的私密数据通过 /SEO/20.html 访问,那么,在 robots.txt 的设置可能如下: User-agent: * Disallow: /SEO/ 这样,攻击者只需看一下 robots.txt 即可知你要隐藏的内容在哪里,在浏览器中输入 /SEO/ 便可访问我们不欲公开的内容。

对这种情况,一般采取如下的办法: 设置访问权限,对/private/中的内容实施密码保护,这样,攻击者便无从进入。

另一种办法是将缺省的目录主文件 index.html 更名为其他,比如说 abc-protect.html,这样,该内容的地址即变成 /SEO/abc-protect.htm,同时,制作一个新的index.html 文件,内容大致为"你没有权限访问此页"之类,这样,攻击者因不知实际的文件名而无法访问私密内容。

2. 如果设置不对,将导致搜索引擎将索引的数据全部删除。

User-agent: * Disallow: / 上述代码将禁止所有的搜索引擎索引数据。

文章出处: /SEO/Robots.txt.html 文章来自: /article/20080711/93438.shtml

- spidertxt用Google网站管理员工具提醒我的网站受到robots.txt文件限制是怎么回事?相关文档

- spidertxtrobots.txt文件中应该屏蔽哪些目录

- spidertxt在网站中的robots.txt是用来干什么的哦?对网站有什么影响啊?

- spidertxt网站robots.txt文件中这些内容是什么意思?

- spidertxtRobots.txt文件是什么文件

NameSilo域名优惠码活动

NameSilo是通过之前的感恩节优惠活动中认识到这家注册商的,于是今天早上花了点时间专门了解了NameSilo优惠码和商家的详细信息。该商家只销售域名,他们家的域名销售价格还是中规中矩的,没有像godaddy域名标价和使用优惠之后的价格悬殊很大,而且其特色就是该域名平台提供免费的域名停放、免费隐私保护等功能。namesilo新注册域名价格列表,NameSilo官方网站:www.namesilo....

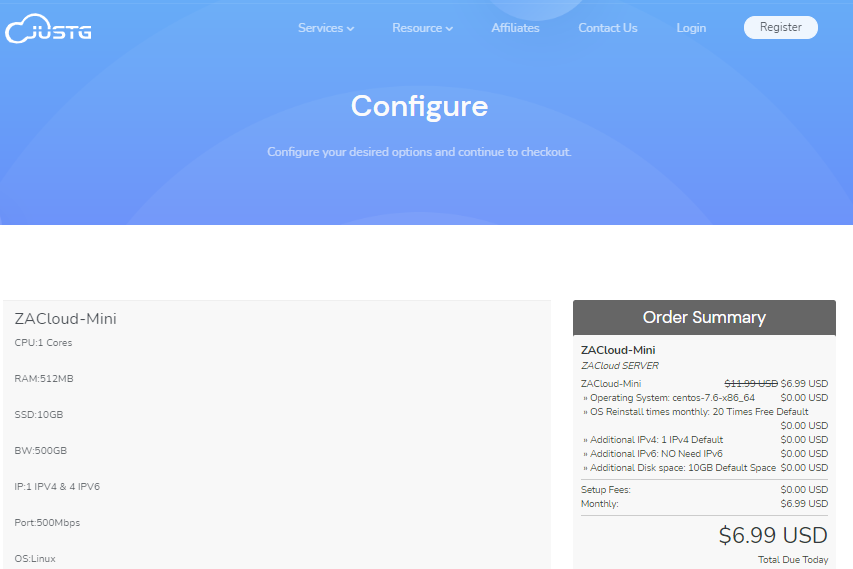

JUSTG(5.99美元/月)最新5折优惠,KVM虚拟虚拟512Mkvm路线

Justg是一家俄罗斯VPS云服务器提供商,主要提供南非地区的VPS服务器产品,CN2高质量线路网络,100Mbps带宽,自带一个IPv4和8个IPv6,线路质量还不错,主要是用户较少,带宽使用率不高,比较空闲,不拥挤,比较适合面向非洲、欧美的用户业务需求,也适合追求速度快又需要冷门的朋友。justg的俄罗斯VPS云服务器位于莫斯科机房,到美国和中国速度都非常不错,到欧洲的平均延迟时间为40毫秒,...

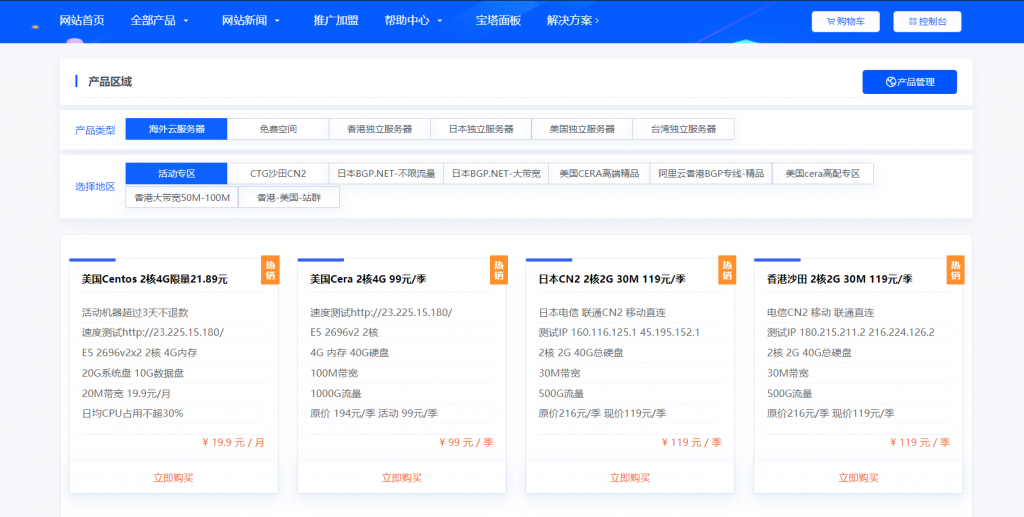

妮妮云(119元/季)日本CN2 2核2G 30M 119元/季

妮妮云的知名度应该也不用多介绍了,妮妮云旗下的云产品提供商,相比起他家其他的产品,云产品还是非常良心的,经常出了一些优惠活动,前段时间的八折活动推出了很多优质产品,近期商家秒杀活动又上线了,秒杀产品比较全面,除了ECS和轻量云,还有一些免费空间、增值代购、云数据库等,如果你是刚入行安稳做站的朋友,可以先入手一个119/元季付的ECS来起步,非常稳定。官网地址:www.niniyun.com活动专区...

-

苹果x和xr哪个好苹果x苹果xr哪个好集成显卡和独立显卡哪个好独立显卡和集成显卡区别??电脑管家和360哪个好360和电脑管家哪个好朗逸和速腾哪个好朗逸和新速腾哪个性能更好点?二手车网站哪个好卖二手车网站哪个好网络机顶盒哪个好什么牌子的网络机顶盒好用?dns服务器设置怎么修改dns服务器360云盘360云盘和百度云盘哪个更好360云盘企业版有什么网盘好用的?360云盘即将停止个人版转向企业版了,百度云限速太厉害不好用,微云感觉空间小了点360云盘关闭360云盘已经关闭了 文件怎么下