登录界面模板PHP写登陆界面!

请教 dw制作登陆界面!

先在dw中建立好站点,然后连接上你的数据库,在dw中新建一个asp网页,在网页中加入登录界面的表单,然后在菜单插入>应用程序对象>用户身份验证>用户登陆,在弹出的界面中选择相应的数据库表、字段对应的到表单的字段中就可以了,不需要写代码。谁能提供我几个登录的页面啊。就像这个网站的样式 http://www.szlovme.com/agent/

? ? 网页小知识:注册/登录方式的设计 当前离线 UID1 帖子464 精华19 积分1942 阅读权限200 性别男 在线时间31 小时 注册时间2007-11-21 最后登录2008-5-2 发表于 2007-11-24 22:26 | 网页小知识:注册/登录方式的设计 1、google google用户注册,允许你用其他站点的email帐号作为你的google帐户。觉得 google在某项服务的情况下,在使用新的服务的时候还是得有个简单的注册。

所以会有“如果已有一个 Google 帐户,即可在此注册。

” 一段这么混乱的文字的一个链接点,“在此注册”是链接到登录的页面的。

(这里说的有点混乱,我的确有点不明解这里。

^_^); 2、baidu baidu的注册信息页是最长的,共有9个选项; 3、抓虾 4、豆瓣 非常简洁,不过简得认为少了一个密码确认,要不然用户按照平常的输入却不小心的按错了也不知道,结果登录不了。

因为用户注册之后反馈的邮件中没有用户资料可以查看; 5、蚂蚁社区 注册过程有些奇怪,顺序是填写你的email,登录你的邮箱,查看你的email,验证你的邮箱,填写你的注册信息,非常异样的郁闷。

用户会不知道是应该用email登录还是用户名登录(我已经困惑好几次); 6、土豆 在注册页有说明,你的email就是你的登录用户名,不用我去困惑我登录是应该用email还是用户名呢?比蚂蚁的email仅仅是验证方式好。

不过这个“用户名”和“昵称”又是怎么一回事呢? 7、巴巴变 不知道和sina啥关系,竟然这么直接了当加粗加颜色指出!没有了困惑人的用户名,不过昵称多了检查有个P用啊,既然我可以修改,我干嘛还需要检查,多此一举。

又是没有确认密码一项! 8、56 很奇怪,登录和注册在同一个页面显示。

总的来说,现在邮箱作为注册帐户是2.0的一个趋势,邮箱都是唯一性的。

但如果是用别的用户名,有别人比你先注册的,你又得想一个名字。

当不同的站需要不同的帐户的时候,你就混乱了。

个人认为,现在注册的需求是1个趋势,4个选项。

1个趋势:用邮箱登录;4个选项:用户名,密码,确认密码,验证码。

当前离线 UID1 帖子464 精华19 积分1942 阅读权限200 性别男 在线时间31 小时 注册时间2007-11-21 最后登录2008-5-2 发表于 2007-11-24 22:28 | 网站优化中应该知道的知识:详细robots.txt 我们知道,搜索引擎都有自己的“搜索机器人”(ROBOTS),并通过这些ROBOTS在网络上沿着网页上的链接(一般是http和src链接)不断抓取资料建立自己的数据库。

对于网站管理者和内容提供者来说,有时候会有一些站点内容,不希望被ROBOTS抓取而公开。

为了解决这个问题,ROBOTS开发界提供了两个办法:一个是robots.txt,另一个是The Robots META标签。

一、 robots.txt 1、 什么是robots.txt? robots.txt是一个纯文本文件,通过在这个文件中声明该网站中不想被robots访问的部分,这样,该网站的部分或全部内容就可以不被搜索引擎收录了,或者指定搜索引擎只收录指定的内容。

当一个搜索机器人访问一个站点时,它会首先检查该站点根目录下是否存在robots.txt,如果找到,搜索机器人就会按照该文件中的内容来确定访问的范围,如果该文件不存在,那么搜索机器人就沿着链接抓取。

robots.txt必须放置在一个站点的根目录下,而且文件名必须全部小写。

网站 URL相应的 robots.txt的 URL 2、 robots.txt的语法 "robots.txt"文件包含一条或更多的记录,这些记录通过空行分开(以CR,CR/NL, or NL作为结束符),每一条记录的格式如下所示: ":"。

在该文件中可以使用#进行注解,具体使用方法和UNIX中的惯例一样。

该文件中的记录通常以一行或多行User-agent开始,后面加上若干Disallow行,详细情况如下: User-agent: 该项的值用于描述搜索引擎robot的名字,在"robots.txt"文件中,如果有多条User-agent记录说明有多个robot会受到该协议的限制,对该文件来说,至少要有一条User-agent记录。

如果该项的值设为*,则该协议对任何机器人均有效,在"robots.txt"文件中, "User-agent:*"这样的记录只能有一条。

Disallow : 该项的值用于描述不希望被访问到的一个URL,这个URL可以是一条完整的路径,也可以是部分的,任何以Disallow 开头的URL均不会被robot访问到。

例如"Disallow: /help"对/help.phpl 和/help/index.phpl都不允许搜索引擎访问,而"Disallow: /help/"则允许robot访问/help.phpl,而不能访问/help/index.phpl。

任何一条Disallow记录为空,说明该网站的所有部分都允许被访问,在"/robots.txt"文件中,至少要有一条Disallow记录。

如果 "/robots.txt"是一个空文件,则对于所有的搜索引擎robot,该网站都是开放的。

下面是一些robots.txt基本的用法: l 禁止所有搜索引擎访问网站的任何部分: User-agent: * Disallow: / l 允许所有的robot访问 User-agent: * Disallow: 或者也可以建一个空文件 "/robots.txt" file l 禁止所有搜索引擎访问网站的几个部分(下例中的cgi-bin、tmp、private目录) User-agent: * Disallow: /cgi-bin/ Disallow: /tmp/ Disallow: /private/ l 禁止某个搜索引擎的访问(下例中的BadBot) User-agent: BadBot Disallow: / l 只允许某个搜索引擎的访问(下例中的WebCrawler) User-agent: WebCrawler Disallow: User-agent: * Disallow: / 3、 常见搜索引擎机器人Robots名字 名称 搜索引擎 Baiduspider Scooter ia_archiver Googlebot FAST-WebCrawler Slurp MSNBOT 4、 robots.txt举例 下面是一些著名站点的robots.txt: 5、 常见robots.txt错误 l 颠倒了顺序: 错误写成 User-agent: * Disallow: GoogleBot 正确的应该是: User-agent: GoogleBot Disallow: * l 把多个禁止命令放在一行中: 例如,错误地写成 Disallow: /css/ /cgi-bin/ /../images/ 正确的应该是 Disallow: /css/ Disallow: /cgi-bin/ Disallow: /../images/ l 行前有大量空格 例如写成 Disallow: /cgi-bin/ 尽管在标准没有谈到这个,但是这种方式很容易出问题。

l 404重定向到另外一个页面: 当Robot访问很多没有设置robots.txt文件的站点时,会被自动404重定向到另外一个Html页面。

这时Robot常常会以处理robots.txt文件的方式处理这个Html页面文件。

虽然一般这样没有什么问题,但是最好能放一个空白的robots.txt文件在站点根目录下。

l 采用大写。

例如 USER-AGENT: EXCITE DISALLOW: 虽然标准是没有大小写的,但是目录和文件名应该小写: user-agent:GoogleBot disallow: l 语法中只有Disallow,没有Allow! 错误的写法是: User-agent: Baiduspider Disallow: /john/ allow: /jane/ l 忘记了斜杠/ 错误的写做: User-agent: Baiduspider Disallow: css 正确的应该是 User-agent: Baiduspider Disallow: /css/ 下面一个小工具专门检查robots.txt文件的有效性: 二、 Robots META标签 1、什么是Robots META标签 Robots.txt文件主要是限制整个站点或者目录的搜索引擎访问情况,而Robots META标签则主要是针对一个个具体的页面。

和其他的META标签(如使用的语言、页面的描述、关键词等)一样,Robots META标签也是放在页面的中,专门用来告诉搜索引擎ROBOTS如何抓取该页的内容。

具体的形式类似(见黑体部分): 网页教学网--提供最新最快的网页技术咨讯 … 2、Robots META标签的写法: Robots META标签中没有大小写之分,name=”Robots”表示所有的搜索引擎,可以针对某个具体搜索引擎写为name=”BaiduSpider”。

content部分有四个指令选项:index、noindex、follow、nofollow,指令间以“,”分隔。

INDEX 指令告诉搜索机器人抓取该页面; FOLLOW 指令表示搜索机器人可以沿着该页面上的链接继续抓取下去; Robots Meta标签的缺省值是INDEX和FOLLOW,只有inktomi除外,对于它,缺省值是INDEX,NOFOLLOW。

这样,一共有四种组合: 其中: 可以写成 ; 可以写成 需要注意的是:上述的robots.txt和Robots META标签限制搜索引擎机器人(ROBOTS)抓取站点内容的办法只是一种规则,需要搜索引擎机器人的配合才行,并不是每个ROBOTS都遵守的。

目前看来,绝大多数的搜索引擎机器人都遵守robots.txt的规则,而对于Robots META标签,目前支持的并不多,但是正在逐渐增加,如著名搜索引擎GOOGLE就完全支持,而且GOOGLE还增加了一个指令“archive”,可以限制GOOGLE是否保留网页快照。

例如: 表示抓取该站点中页面并沿着页面中链接抓取,但是不在GOOLGE上保留该页面的网页快照。

| || GMT+8, 2010-9-23 19:17, Processed in 0.050145 second(s), 3 queries, Gzip enabled. Powered by 7.0.0

电脑登录界面是什么格式的?

Windows XP登陆界面就是你的操作系统启动到输入密码的时候的界面,默认一般是蓝色的,密码框在屏幕的右方。

调取的系统system32下的logonui.exe文件,当然这个是可以更换的。

这里告诉大家一个最简单的方法,我估计,只要会看网页就能做吧?

下面来操作吧。

第一步,找喜欢的壁纸URL

去搜索自己喜欢的壁纸,比如google,baidu上面搜索“海贼王 壁纸”,找到喜欢的壁纸,复制壁纸图片的路径,注意格式必须是.JPG/.GIF/.PNG其中的一种;而且宽度范围1024-1920 高度范围768-1440;

打开 XP登陆界面在线制作网站: / ,选择一款喜欢的模板,他们的区别主要是登陆账户的位置、字体颜色、输入框图片等不同,不过你都可以试试,看看到底哪一个效果你最喜欢。

接着在“登陆界面图片URL ”那里粘贴你刚复制的壁纸URL路径,

远程图片URL:可以来自网络任意可以外连地址,需要JPG/GIF/PNG 后缀格式,粘贴过来即可;

本地上传图片:可以将你电脑里的图片上传到网站上,制作为登陆界面,但文件大小必须在500KB以内;

在正常情况下,一般5分钟内可以去到登陆界面文件,下载后的文件为EXE格式,我们还需要一个登陆界面更换软件,那就是ReplaceUI,小巧,绿色。

用他更换掉系统默认的界面,替换后用 Win+L 键观看效果。

一、网络中的图片格式一定要按要求(格式必须是.JPG/.GIF/.PNG/BMP 其中的一种;而且宽度范围1024-1920 高度范围768-1440);

PHP写登陆界面!

1.先建立一个登录表单。(这都是HTML,不解释了)。

2.开始写PHP的处理程序,在刚才写的代码的上面开始写: $username = "admin"; //要登录的账号 $pwd = "123456"; //要使用的密码 if ($username==$_POST[username]&&$pwd==$_POST[pwd]){ echo "登陆成功!"; }else{ echo "账号或密码错误"; exit(); } 其实这个就是一个很简单的用户系统。

我也是新手。

其实PHP100的教程就不错,我就是跟着那个自学的

- 登录界面模板PHP写登陆界面!相关文档

- 登录界面模板如何制作php登陆界面

- 登录界面模板如何用html5+ css div制作一个简单的登录界面

- 登录界面模板如何从头制作一个html5登录页面

- 登录界面模板怎么做网站注册和登入页面

DiyVM:499元/月香港沙田服务器,L5630*2/16G内存/120G SSD硬盘/5M CN2线路

DiyVM是一家成立于2009年的国人主机商,提供的产品包括VPS主机、独立服务器租用等,产品数据中心包括中国香港、日本大阪和美国洛杉矶等,其中VPS主机基于XEN架构,支持异地备份与自定义镜像,VPS和独立服务器均可提供内网IP功能。商家VPS主机均2GB内存起步,三个地区机房可选,使用优惠码后每月69元起;独立服务器开设在香港沙田电信机房,CN2线路,自动化开通上架,最低499元/月起。下面以...

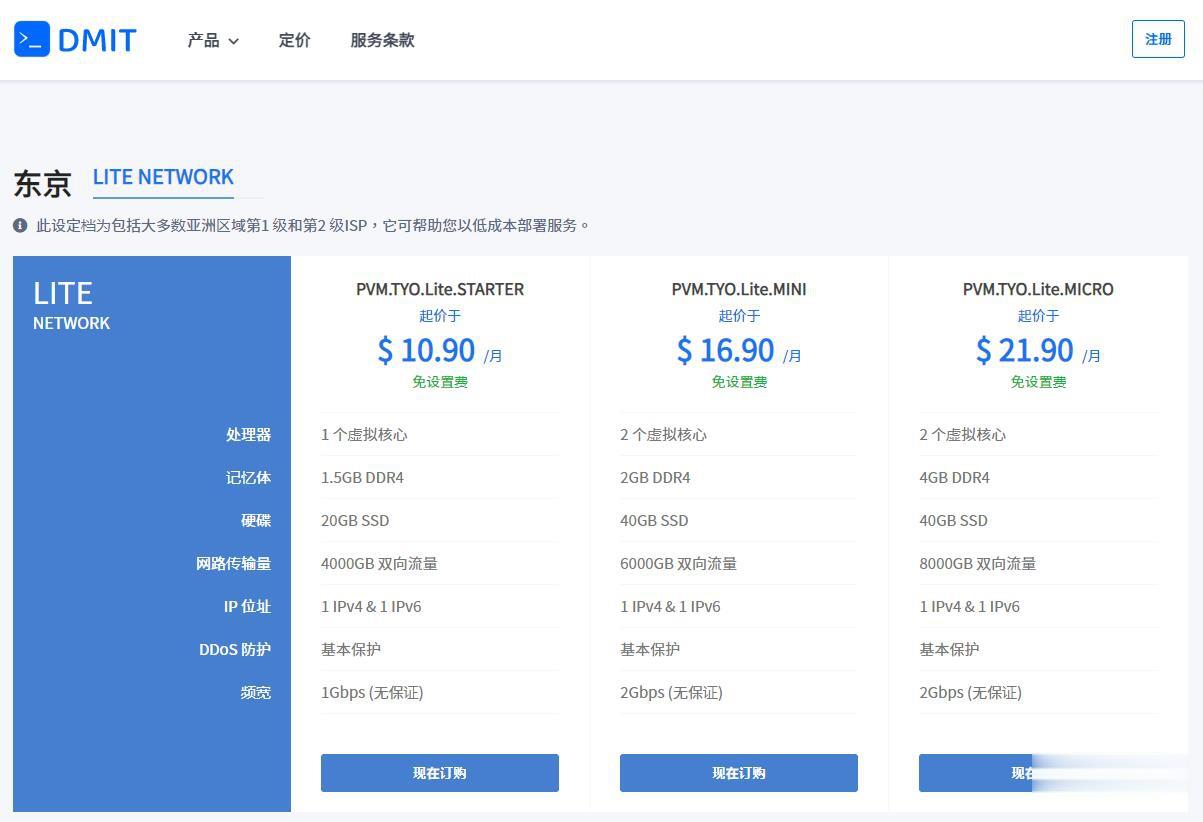

DMIT$10.9/月,日本VPS/三网直连/1核1.5G内存/20GB存储/1Gbps端口

优惠码年付一次性5折优惠码:TYO-Lite-Open-Beta-1y-50OFF永久8折优惠码:TYO-Lite-Open-Beta-Recur-20OFF日本vpsCPU内存SSD流量带宽价格购买1核1.5G20 GB4 TB1Gbps$10.9/月购买2核2 G40 GB6 TB1Gbps$16.9/月购买2核4 G60 GB8 TB1Gbps$21.9/月购买4核4 G80 GB12 TB...

SugarHosts糖果主机六折 云服务器五折

也有在上个月介绍到糖果主机商12周年的促销活动,我有看到不少的朋友还是选择他们家的香港虚拟主机和美国虚拟主机比较多,同时有一个网友有联系到推荐入门的个人网站主机,最后建议他选择糖果主机的迷你主机方案,适合单个站点的。这次商家又推出所谓的秋季活动促销,这里一并整理看看这个服务商在秋季活动中有哪些值得选择的主机方案,比如虚拟主机最低可以享受六折,云服务器可以享受五折优惠。 官网地址:糖果主机秋季活动促...

-

android打包签名如何查看Android应用程序签名打包信息多重阴影[讨论]《多重阴影》的中文配音好熟悉啊!电梯物联网平台电梯物联网技术运用到电梯的远程监控上,能实现什么作用?linux操作系统好吗Linux操作系统和WINDOWS7操作系统哪个好慕课网址如何加入慕课学习课程?handoff怎么用Hand off怎么用?修改qq密码保护怎么改QQ密码,还有改密保买卖论坛请推荐几个二手手机论坛,越多越好如何修改手机ip安卓手机怎么改ip地址腾讯windows10升级助手win10升级助手登录失败怎么办 win10升级助手不能登录解决办法